Für ein optimales Hörerlebnis empfehlen wir eine Podcatcher-App zu verwenden. Zum Beispiel:

- AntennaPod (Android)

- gPodder (Desktop)

- GNOME-Podcast (GNOME-Desktop)

- Kast (KDE-Desktop)

- PodPhoenix (Ubuntu-Touch)

Der RSS-Feeds für den Podcast lautet: https://gnulinux.ch/podcast/gnulinux_newscast_rss.xml. Ihr findet uns in den Podcast-Verzeichnissen unter dem Suchbegriff: "GNU/Linux".

Wenn euch der Podcast gefällt, freuen wir uns über eine Unterstützung. Vielen Dank!

Shownotes

CIW - Folge 074 - 21.02.2024 - Wasserzeichen

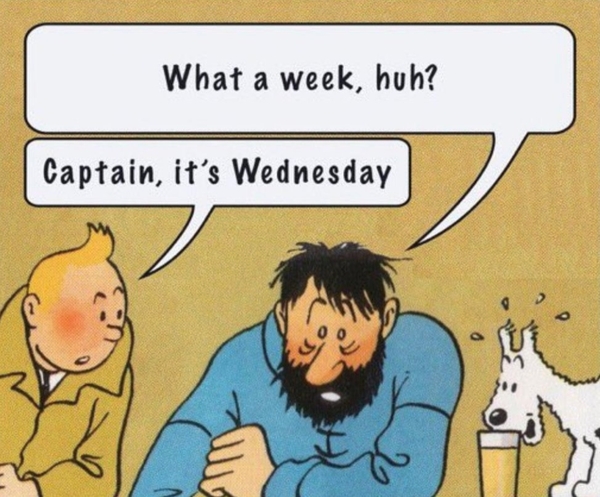

- Wir begrüssen alle Hörerinnen und Hörer zur Folge 74 von "Captain it's Wednesday", dem Podcast über Freie Software und Freie Gesellschaft, aufgenommen am 19. Februar von Felix Daum und Ralf Hersel.

Hausmitteilungen

- TuxWiz-Videos am Samstag

- Wir bedanken uns bei unseren Spendern: Ingmar, Folker, Andris, Andreas, Michael, Remo, Klaus-Dieter, Rolf, Florian, Michel, Julius, Sami, Winfried, Patrick unserem neuen Sponsor Aitus und allen Namenlosen, die uns über Liberapay unterstützen. Herzlichen Dank dafür.

Thema: Was bringen Wasserzeichen bei KI-generierten Inhalten?

KI-generierte Inhalte werden immer allgegenwärtiger, weitreichender und hochwertiger. Das fängt bei Texten an, betrifft Fotos, Grafiken und Videos, wie OpenAI in der vergangenen Woche mit SORA gezeigt hat. Wenn wir "Texte" sagen, meinen wir durch KI erzeugte Doktorarbeiten, Gerichtsurteile, Gesetzesentwürfe, Prosa und Poesie. Die Grafiken subsumieren technische Zeichnungen, Baupläne und alles im Bereich des Grafikdesigns. Bei Fotos und Videos bekommen wir es mit Pressebildern, Beweisfotos, Nachrichtensendungen, Spielfilmen und Dokumentationen zu tun. Aber auch im Bereich der Konvertierung von Text (Zusammenfassung, Übersetzung) und Sprache (text-to-speech, in-time Übersetzung) gibt es grosse Fortschritte.

Der Schritt zum Gegenständlichen ist nicht weit: "KI, entwirf mir eine Medizin gegen meine Kopfschmerzen und, 3D-Drucker, druck mir eine Tablette gemäss der ermittelten Formel." Oder so: "3D-Drucker, druck mir ein Haus für vier Personen, auf diesem Grundstück und laut folgenden Anforderungen und Preisbudget."

Nun beginnen KI-Provider wie Meta, Adobe oder Google damit, die mit ihren Werkzeugen generierten Inhalte mit Wasserzeichen zu versehen. Das soll der Verbreitung von Desinformation entgegenwirken. Durch die zunehmende Perfektionierung der generierten Ergebnisse sind diese von menschlich erzeugten Inhalten nicht mehr unterscheidbar; auch nicht von Fachleuten. Dabei kommen zwei Verfahren zum Einsatz: Hinweise in den Metadaten eines KI-Inhaltes und versteckt eingebettete Hinweise in den Nutzdaten eines KI-Inhaltes. Dafür werden meist steganografische Methoden verwendet, die maschinell prüfbar, jedoch dem Anwender nicht offensichtlich sind. Das funktioniert bei Bildern und Videos gut, ist aber bei Texten schwieriger. Dabei muss man auf linguistische Verfahren zurückgreifen, mit denen syntaktische und semantische Veränderungen zur Einbettung eines Wasserzeichens verwendet werden.

Diese Massnahmen sollen den Nutzern bewusst machen, dass nicht alle Inhalte, die sie online sehen, auf authentischen Begebenheiten beruhen. Das übergeordnete Ziel ist es, eine informierte Nutzerschaft zu fördern, die in der Lage ist, zwischen realen und künstlich erzeugten Inhalten zu unterscheiden.

Leider wird das nicht funktionieren. Metadaten werden beim Hochladen auf Social-Media-Plattformen in der Regel entfernt. Ausserdem sind Metadaten sichtbar und manipulierbar. Die Wasserzeichen haben das Problem, dass sie nicht allen Transformationen standhalten. Bildmanipulationen wie Drehen, Stauchen, Grössenänderungen, Filtern usw. machen die Wasserzeichen schnell zunichte. Wie zuvor erwähnt, bei Texten ist es viel schwieriger Wasserzeichen einzubringen. Selbst wenn man das schafft, überstehen sie nicht die Umformulierung oder Kürzung des Textes. Meta behauptet zwar, dass ihr Wasserzeichen sehr stabil gegen Manipulationen sei, was zu beweisen wäre.

Die eigentliche Herausforderung liegt jedoch in der Wahrhaftigkeit, die mit Wasserzeichen suggeriert wird. Falls sich Wasserzeichen für KI-Inhalte durchsetzen sollten, was niemals zu 100 % geschehen wird, nimmt die Anwenderin an, dass sie der Kennzeichnung vertrauen kann. Das ist natürlich nicht so. Jeder Despot oder Propagandaminister würde zuerst die Metadaten anpassen und dann das Wasserzeichen unkenntlich machen. Genauso wäre es möglich, dass KI-Wasserzeichen auf menschliche Inhalte gesetzt werden, was ebenfalls die Wahrheit verfälscht.

Apropos Despot und Propagandaminister: Wenn man durch Wasserzeichen den Urheber zurückverfolgen kann, ist das problematisch für z. B. Menschenrechtsaktivisten. Es muss also dafür gesorgt werden, dass persönliche Informationen bzw. den Rückschluss auf einzelne Personen nicht möglich ist.

Doch auch das umgekehrte Vorgehen führt zu nichts. Das wäre, wenn menschengemachte Inhalte als solche gekennzeichnet würden. Hierbei ist die Wahrscheinlichkeit, dass das flächendeckend geschieht, sehr gering. Man könnte einen Hashwert für Inhalte erzeugen, so wie das bei Softwarepaketen üblich ist. Das bedingt jedoch eine zweite Datei und das Wissen darüber, wie man einen solchen Hashwert überprüft. Für den Normalgebrauch ist das völlig unrealistisch.

Welche Annahmen kann man nun treffen, wenn man eine Datei vorliegen hat? Wenn ein Inhalt per Metadaten und/oder Wasserzeichen als KI-generiert gekennzeichnet ist, kann man dem glauben, oder nicht. Eine KI-Kennzeichnung kann auch auf einen menschengemachten Inhalt eingefügt werden. Falls der Inhalt keine KI-Kennzeichnung enthält, heisst das genauso wenig. Die Datei kann echt sein, oder nicht. Und dabei reden wir noch nicht über Mixed-Content, also der künstlerischen Kombination von eigenen und KI-Inhalten. Aber auch Digitales Rechtemanagement kann umgegangen werden, bietet aber trotzdem einen gewissen Schutz. Der Unterschied ist, dass sich mit fotorealistischen Bildern großen Schaden anrichten lässt.

Wir werden lernen müssen, mit der Problematik umzugehen. Dafür benötigen wir eine notwendige Medienkompetenz. Selbstverständlich ist es heute nötig, einen Inhalt kritisch zu hinterfragen und im Kontext zu betrachten. Dafür braucht es mehrere Voraussetzungen:

- Kenntnis des Problems

- Wissen, wie damit umzugehen ist

- Der Wille und die Zeit, den Zusatzaufwand in die Anwendung der Medienkompetenz zu stecken.

Vermutlich wird es am letzten Punkt scheitern. Bei der heutigen Medienfülle investieren die Wenigsten diesen Zusatzaufwand.

Links

https://www.heise.de/news/OpenAI-integriert-eine-Art-Wasserzeichen-in-generierte-Bilder-9622526.html

https://de.wikipedia.org/wiki/Steganographie

https://ai.meta.com/blog/stable-signature-watermarking-generative-ai/

https://arxiv.org/pdf/2310.00076.pdf

https://arxiv.org/pdf/2306.01953.pdf

Outro

- Euer Feedback ist uns wichtig. Ihr könnt uns über Matrix, Mastodon oder per E-Mail erreichen. Die Adressen findet ihr auf unserer Webseite.

- GNU/Linux.ch ist ein Magazin, in dem die Community für die Community interessante Artikel erstellt und im Podcast darüber diskutiert. Helft mit, die Infos für die Community zu bereichern. Wie das geht, erfahrt ihr hier.

Hallo zusammen,

ich möchte die Frage aufwerfen, ob es nicht möglich wäre, ein ähnliches Verfahren wie bei E-Mail-Signaturen auch für Bilder und Videos anzuwenden und sie direkt in die Medien einzubetten. Diese Einbettung könnte durch Grafikdesigner und Künstler erfolgen, Personen also, die professionell tätig sind und von ihren Werken leben.

Im Gegensatz dazu betten KI-Generatoren automatisch ihre Wasserzeichen ein. Es könnte sich also um eine hybride Lösung handeln.

Beste Grüße aus dem Schwarzwald